L’accès du grand public à la puissance de diffusion du Web ainsi que les flots de données numériques qui coulent désormais de toutes les activités humaines nous confrontent au problème suivant : comment transformer les torrents de données en fleuves de connaissances ? Certains observateurs enthousiastes du traitement statistique des « big data », comme Chris Anderson, (l’ancien rédacteur en chef de Wired), se sont empressés de déclarer que les théories scientifiques – en général! – étaient désormais obsolètes [Voir : de Chris Anderson « The End of Theory: The Data Deluge Makes the Scientific Method Obsolete », Wired, 23 juin 2008.] Nous n’aurions plus besoin que de mégadonnées et d’algorithmes statistiques opérant dans les centres de calcul : les théories – et donc les hypothèses qu’elles proposent et la réflexion dont elles sont issues – appartiendraient à une étape révolue de la méthode scientifique. Il paraît que les nombres parlent d’eux-mêmes. Mais c’est évidemment oublier qu’il faut, préalablement à tout calcul, déterminer les données pertinentes, savoir exactement ce que l’on compte et nommer – c’est-à-dire catégoriser – les structures émergentes. De plus, aucune corrélation statistique ne livre directement des relations causales. Celles-ci relèvent nécessairement d’hypothèses qui expliquent les corrélations mises en évidence par les calculs statistiques. Sous couvert de pensée révolutionnaire, Chris Anderson et ses émules ressuscitent la vieille épistémologie positiviste et empiriste en vogue au XIXe siècle selon laquelle seuls les raisonnements inductifs (c’est-à-dire uniquement basés sur les données) sont scientifiques. Cette position revient à refouler ou à passer sous silence les théories – et donc les hypothèses risquées fondées sur une pensée personnelle – qui sont nécessairement à l’oeuvre dans n’importe quel processus d’analyse de données et qui se manifestent par des décisions de sélection, d’identification et de catégorisation. On ne peut initier un traitement statistique et interpréter ses résultats sans aucune théorie. Le seul choix que nous ayons est de laisser les théories à l’état tacite ou de les expliciter. Expliciter une théorie permet de la relativiser, de la comparer avec d’autres théories, de la partager, de la généraliser, de la critiquer et de l’améliorer [Parmi la très abondante littérature sur le sujet, voir notamment les ouvrages de deux grands épistémologues du XXe siècle, Karl Popper et Michael Polanyi]. Cela constitue même une des principales composantes de ce qu’il est convenu d’appeler « la pensée critique », que l’éducation secondaire et universitaire est censée développer chez les étudiants.

Outre l’observation empirique, la connaissance scientifique a toujours eu à voir avec le souci de la catégorisation et de la description correcte des données phénoménales, description qui obéit nécessairement à des théories plus ou moins formalisées. En décrivant des relations fonctionnelles entre des variables, la théorie offre une prise conceptuelle sur le monde phénoménal qui permet (au moins partiellement) de le prévoir et de le maîtriser. Les données d’aujourd’hui correspondent à ce que l’épistémologie des siècles passés appelait les phénomènes. Pour continuer de filer cette métaphore, les algorithmes d’analyse de flots de données correspondent aux instruments d’observation de la science classique. Ces algorithmes nous montrent des patterns, c’est-à-dire en fin de compte des images. Mais ce n’est pas parce que nous sommes capables d’exploiter la puissance du médium algorithmique pour « observer » les données qu’il faut s’arrêter en si bon chemin. Nous devons maintenant nous appuyer sur la puissance de calcul de l’Internet pour « théoriser » (catégoriser, modéliser, expliquer, partager, discuter) nos observations, sans oublier de remettre cette théorisation entre les mains d’une intelligence collective foisonnante.

Tout en soulignant la distinction entre corrélation et causalité dans leur livre de 2013 sur les big data, Viktor Mayer-Schonberger et Kenneth Cukier annoncent que nous nous intéresserons de plus en plus aux corrélations et de moins en moins à la causalité, ce qui les range dans le camp des empiristes. Leur livre fournit néanmoins un excellent argument contre le positivisme statistique. Ils racontent dans leur ouvrage la très belle histoire de Matthew Maury, un officier de marine américain qui, vers le milieu du XIXe siècle, agrégea les données des livres de navigation figurant dans les archives officielles pour établir des cartes fiables des vents et des courants [In Big Data: A Revolution… (déjà cité) p. 73-77]. Certes, ces cartes ont été construites à partir d’une accumulation de données empiriques. Mais je fais respectueusement remarquer à Cukier et Mayer-Schonberger qu’une telle accumulation n’aurait jamais pu être utile, ou même simplement faisable, sans le système de coordonnées géographique des méridiens et des parallèles… qui est tout sauf empirique et basé sur des données. De la même manière, ce n’est qu’en adoptant un système de coordonnées sémantique que nous pourrons organiser et partager les flots de données de manière utile.

Aujourd’hui, la plupart des algorithmes qui gèrent l’acheminement des recommandations et la fouille des données sont opaques, puisqu’ils sont protégés par le secret commercial des grandes compagnies du Web. Quant aux algorithmes d’analyse, ils sont, pour la plupart, non seulement opaques, mais aussi hors d’atteinte de la majorité des internautes pour des raisons à la fois techniques et économiques. Or il est impossible de produire de la connaissance fiable au moyen de méthodes secrètes. Bien plus, si l’on veut résoudre le problème de l’extraction d’information utile à partir du flot diluvien des big data, on ne pourra pas éternellement se limiter à des algorithmes statistiques travaillant sur le type d’organisation de la mémoire numérique dont nous disposons en 2017. Il faudra tôt ou tard et le plus tôt sera le mieux, implémenter une organisation de la mémoire conçue dès l’origine pour les traitements sémantiques. On ne pourra apprivoiser culturellement la croissance exponentielle des données – et donc transformer ces données en connaissance réfléchie – que par une mutation qualitative du calcul.

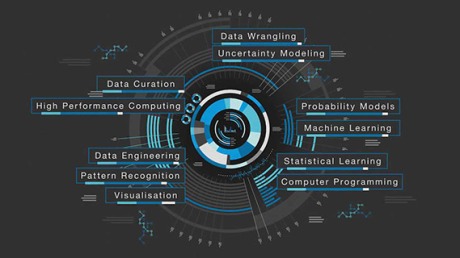

Retenons que la « science des données » (data science en anglais) devient une composante essentielle de la compréhension des phénomènes économiques et sociaux. Plus aucune organisation ne peut s’en passer. Au risque de marcher à l’aveugle, les stratégies économiques, politiques et sociales doivent s’appuyer sur l’art d’analyser les mégadonnées. Mais cet art ne comprend pas seulement les statistiques et la programmation. Il inclut aussi ce que les américains appellent la « connaissance du domaine » et qui n’est autre qu’une modélisation ou une théorie causale de la réalité analysée, théorie forcément d’origine humaine, enracinée dans une expérience pratique et orientée par des fins. Ce sont toujours les humains et leurs récits producteurs de sens qui mobilisent les algorithmes.

[…] la science des données (Pierre Lévy’s Blog, 18 January 2017 […]

LikeLike

Excellente analyse fluide qui nous change des essais verbeux récents.

LikeLike

[…] et la réorganisation de données nécessitent les théories comme une orientation (Sur la science des données, Levy, […]

LikeLike

[…] son billet « Sur la science des données » à propos de certains développements excessifs concernant le « big […]

LikeLike

[…] sont toujours les humains et leurs récits producteurs de sens qui mobilisent les algorithmes.» (Sur la science des données, Levy, […]

LikeLike

[…] Sur la science des données […]

LikeLike