Mon but est d’inciter les enseignants à mobiliser l’intelligence collective (IC) au service des apprentissages et à prendre avantage des nouvelles possibilités pédagogiques ouvertes par une intelligence artificielle (IA) que nos élèves utilisent déjà, quoique ce ne soit pas toujours de manière adéquate. Je vais commencer par expliquer en quoi l’intelligence collective devrait faire partie intégrante de nos stratégies d’enseignement, puis je vais esquisser quelques pistes d’utilisation de l’IA au service d’une pédagogie centrée sur l’intelligence collective. Le “nous” – première personne du pluriel – de ce texte désigne les enseignants en général, et plus particulièrement les enseignants du secondaire. Je me compte dans ce collectif puisque j’ai enseigné pendant quarante ans au secondaire, au supérieur et dans la formation professionnelle. J’ai pratiqué ce que je prêche, à savoir l’utilisation des technologies numériques pour faciliter l’apprentissage en intelligence collective. Ce texte est une version augmentée de mon post précédent. Je l’ai préparée en vue d’une communication au 6e Colloque interdisciplinaire et intersectoriel en enseignement secondaire du Québec le 20 mars 2026.

L’intelligence collective nous précède, nous excède et nous succède

Depuis plus de trente ans, j’ai traité de l’intelligence collective de toutes les manières possibles. Je l’aborde ici sous l’angle temporel et dans la perspective de l’enseignement. L’IC qui nous précède vient du passé : nous sommes en position de recevoir. Celle qui nous excède nous ouvre à la collaboration au présent. Celle qui nous succède vise l’avenir : nous avons la responsabilité de la transmission.

L’intelligence collective nous précède

L’IC nous précède : nous avons reçu nos langues et nos savoirs. Nos savoir-faire et nos outils nous ont été transmis. Les idéaux qui nous animent mobilisaient déjà les générations antérieures. Les paysages, les villes où nous évoluons ont été construits par d’autres. Les bibliothèques (matérielles ou virtuelles) où nous apprenons ont été rédigées par d’innombrables auteurs qui s’entrelisaient. Le propre de l’apprentissage est de s’abreuver à la mémoire collective et, à l’heure où les sources numériques sont abondantes, le rôle des enseignants est plus que jamais de donner soif.

Qu’est-ce que cela signifie sur le plan de l’éducation? Qu’il nous faut utiliser nous-mêmes autant que possible la mémoire disponible afin de supporter l’apprentissage de nos élèves. Mais aussi que nous devons les entraîner à prendre avantage de cette mémoire puisque plus aucun obstacle matériel ne s’interpose entre eux et l’intelligence collective accumulée. Il nous faut donc développer les compétences qui leur permettront de chercher, de trouver et de consulter utilement les livres dans les bibliothèques et les supports audio-visuels dans les médiathèques. Nous devons également leur donner les outils intellectuels et les réflexes nécessaires à la navigation sur le Web et les bases de données. Enfin, nous devons leur enseigner la bonne manière d’utiliser l’IA contemporaine qui mobilise le savoir accumulé par les bibliothèques et les données numériques, une IA qui est aussi capable de personnaliser ce savoir en fonction des capacités et des besoins des élèves.

L’intelligence collective nous excède

L’intelligence collective nous excède car chacun de nous ne dispose directement que d’une toute petite partie des savoirs, des compétences et des savoir-être qui font vivre le monde contemporain. D’où la nécessité de la collaboration et de l’ouverture à l’autre qui doivent être pratiquées et valorisées dès la phase d’apprentissage scolaire. De plus, l’apprentissage est une entreprise essentiellement sociale. Cela non seulement parce que la camaraderie de l’effort en commun soutient l’entraide et l’enthousiasme, mais aussi parce que chacun possède une expérience, une compréhension, un point de vue original qui peut illuminer les autres et éclairer leurs angles morts. Le dialogue pédagogique doit être non seulement vertical (maître / élève) mais aussi horizontal (entre élèves… et entre enseignants!). On peut concevoir le rôle de l’enseignant comme un animateur de l’intelligence collective de ses étudiants. J’ai moi-même utilisé les médias sociaux en classe pour stimuler l’apprentissage en intelligence collective. Une expérience enrichissante pour tout le monde!

La mobilisation de l’intelligence collective des élèves suppose une stratégie pédagogique adéquate. Il faut d’abord que l’enseignant joue correctement son rôle de chef d’orchestre. Les finalités des exercices doivent être énoncées clairement et leur compréhension doit être vérifiée avant que les élèves soient lancés dans la collaboration. L’enseignant doit accompagner et motiver les élèves tout au long du déroulé des activités. Un point capital : l’évaluation doit être pensée en vue du fonctionnement en intelligence collective. On préfèrera les approches qui “gamifient” la distribution des points ou des notes selon des règles claires qui s’appliquent également à tout le monde. Il est même possible de procéder à des évaluations collectives croisées dans lesquelles les élèves participent à leur propre notation. Car qu’est-ce que l’esprit critique sinon la capacité à exercer un jugement de manière responsable, y compris sur son propre travail et celui de ses pairs? Je parlais à mes élèves en comparant les exercices que je leur donnais à l’entraînement de futurs “ninjas” de la connaissance. Il s’agissait de viser l’excellence dans les savoirs objectifs, dans les compétences pratiques mais aussi dans les savoir-être et les habiletés collaboratives. La compréhension des buts communs, le respect des règles du jeu et l’entraide (on n’abandonne jamais un camarade au sol!) sont aussi importants que l’apprentissage des contenus.

Mais les enseignants doivent eux aussi s’engager dans l’intelligence collaborative. Cela suppose qu’au lieu d’attendre des formations institutionnelles, ils ou elles adoptent une attitude d’apprentissage et de recherche permanents. Une fois que l’on a déterminé ses priorités en la matière, la meilleure méthode reste la constitution d’un réseau d’apprentissage personnel. Cela consiste à trouver sur les canaux adéquats (Linkedin, groupes Facebook, forums de discussion divers) les experts des domaines dans lesquels on veut se former et progresser, puis à échanger avec ces experts et à apprendre de leurs expériences. Forts de nos expériences et de nos essais et erreurs, nous pouvons même devenir nous-mêmes des experts et aider nos collègues.

L’intelligence collective nous succède

L’intelligence collective nous succède : après avoir (presque) tout reçu, à notre tour de transmettre ce que nos parcours scolaires, professionnels et existentiels nous ont appris, en adaptant nos acquis aux besoins variés et aux nouvelles circonstances de nos interlocuteurs et de nos collaborateurs. D’ailleurs, on n’apprend jamais aussi bien une matière que lorsqu’on doit l’enseigner. S’adresser à l’autre ou déposer un élément d’expertise dans une mémoire collective nous oblige à clarifier des concepts implicites, à systématiser un savoir empirique, à décontextualiser le contenu d’une expérience. Ce faisant, nous permettrons à la connaissance de circuler et à nos destinataires connus ou inconnus de se l’approprier plus facilement. Encore une autre façon de participer à l’intelligence collective.

Que signifie cette idée que l’intelligence collective nous succède, dans le domaine de l’éducation? Le succès en éducation, c’est ce qui reste une fois que le cours est terminé et que le groupe classe se disperse. Les connaissances ont-elles été acquises? Les compétences ont-elles été intégrées? Nos étudiants ont-ils pris conscience, si peu que ce soit, de leur responsabilité personnelle dans la constitution, l’entretien et la transmission de la mémoire collective? Chaque texte, image ou autre publié sur le Web, chaque dépôt de données numériques, chaque interaction avec Perplexity, Claude ou ChatGPT, tout cela contribue à l’édification de la mémoire collective et à l’entraînement des IA. Nous ne sommes pas seulement en aval de l’intelligence collective, mais aussi en amont.

L’intelligence artificielle dans l’éducation

Philosophie générale

Une fois posé le socle de l’intelligence collective, passons à l’intelligence artificielle pour l’apprentissage. Il faut d’abord caractériser correctement l’intelligence artificielle générative contemporaine (ChatGPT, Claude, Gemini, Grok, Perplexity, etc.). Plutôt qu’une intelligence mécanique « autonome » c’est en réalité une compression statistique de l’immense mémoire numérique qui a servi à son entrainement. L’IA doit être considérée comme une mobilisation de la mémoire collective au bénéfice de ses usagers. C’est une manifestation de l’intelligence collective passée et contemporaine. En d’autres termes, l’IA est une interface numérique entre l’intelligence collective accumulée et l’intelligence vivante des étudiants et des professeurs.

Sur un plan pédagogique, je crois qu’il faut désormais inclure l’IA dans nos scénarios pédagogiques et ne pas hésiter à évaluer sa bonne utilisation par nos étudiants. Elle a un rôle à jouer dans l’intelligence collective du groupe classe, en dialogue ouvert avec le professeur et les étudiants. L’IA peut servir d’interlocuteur dans des débats où les élèves travaillent en apprentissage collaboratif. Par exemple, elle peut aider à compiler et structurer les idées générées collectivement, à organiser les contributions individuelles en un document cohérent que le groupe critique et améliore ensemble. L’IA ne doit pas remplacer les interactions humaines, il faut plutôt l’utiliser comme catalyseur pour enrichir la réflexion collective et approfondir les apprentissages.

Quelles sont les compétences-IA indispensables à faire acquérir par les étudiants?

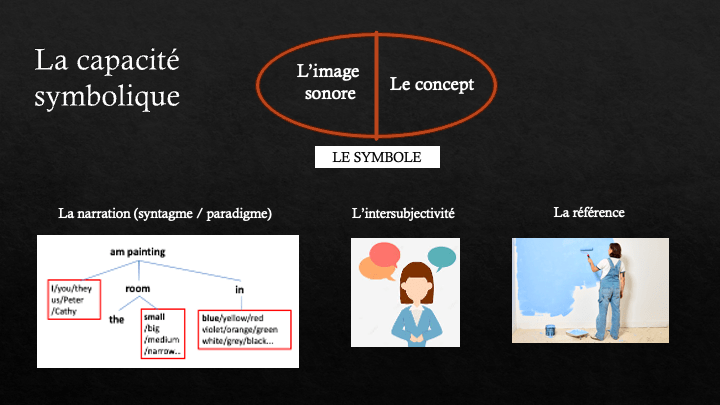

La pertinence linguistique. La principale compétence à acquérir est de type conceptuel et linguistique. En effet, plus le langage de la consigne (le “prompt”) ou de la question est cohérent, élaboré et précis, meilleur sera le résultat. Car, en fonction de la qualité et du niveau de connaissance manifesté par la consigne, l’IA va mobiliser les zones de ses données d’apprentissage qui sont de la meilleure ou de la pire qualité. En un sens, l’IA offre un miroir à l’intelligence de l’élève. Il peut être utile de comparer – avec les étudiants – les réponses au même problème en fonction de la qualité de la question. La réponse diffère d’une tournure de phrase à l’autre, voire d’un mot à l’autre.

L’esprit critique. Les IA sont des machines probabilistes. C’est pourquoi elles commettent inévitablement des erreurs. L’étudiant doit donc avoir l’esprit en alerte et vérifier les citations, les faits, les affirmations péremptoires de la machine. L’esprit critique doit non seulement être mobilisé contre les fameuses “hallucinations” mais aussi contre les biais des données d’entraînement. L’IA ne dit pas la vérité : elle se contente de reproduire ce qu’elle a appris. Or l’opinion de la majorité, ou celle qui a été mobilisée par une consigne particulière, n’est pas nécessairement correcte. Sans tomber dans la paranoïa, il faut se souvenir que des acteurs mal intentionnés “empoisonnent” les données d’entraînement afin d’influencer les utilisateurs naïfs de l’IA.

La persévérance. Les premières réponses ne sont pas nécessairement les meilleures. Il faut apprendre à questionner encore et encore, à comparer les réponses d’une IA avec celles d’une autre, prendre le temps de suivre les liens web en référence, etc.

Quelques stratégies pédagogiques pour une utilisation de l’IA en intelligence collective

La dialectique de l’apprentissage. Avec l’IA utilisée dans une perspective d’intelligence collective, l’apprentissage s’effectue selon une dialectique à quatre pôles: la guidance de l’enseignant ; la mémoire personnelle de l’élève ; le dialogue des étudiants avec leurs pairs ; l’intelligence artificielle qui mobilise la mémoire collective accumulée. Dans ce cadre général, la facilitation des conversations et l’interaction avec une mémoire partagée sont parmi les usages les plus utiles de l’IA pour l’éducation.

L’interaction avec une mémoire collective. L’IA peut devenir l’interface d’une base de connaissance spécifique au groupe classe contenant les sources du cours : textes historiques, articles scientifiques, notes de cours, etc. Elle permet alors d’interroger facilement le contenu sans risques d’hallucinations et de générer à la demande des supports audio et visuels qui résument la matière. L’expérience de l’interaction avec une mémoire partagée, particulièrement lorsque les étudiants ont la possibilité de l’enrichir eux-mêmes, est un levier important pour l’acquisition d’une compétence en intelligence collective.

La facilitation des conversations. L’enseignant devient un chef d’orchestre de l’intelligence collective assistée par l’IA. Lors de séances de brainstorming l’IA peut reformuler certaines contributions pour les rendre plus claires, compiler et structurer les idées émises par les élèves. Elle peut également proposer des synthèses intermédiaires que le groupe critique et améliore. Dans les débats argumentés, l’IA peut jouer le rôle d’un adversaire ou d’un allié. Par exemple, elle peut défendre un point de vue opposé à celui du groupe, obligeant les élèves à affiner leurs arguments. Le collectif d’apprentissage peut encore utiliser l’IA pour générer des questions stimulantes qui nourrissent la réflexion collective plutôt que de donner des réponses.

L’écriture collaborative. Les élèves doivent rédiger une nouvelle collective : dans ce cadre l’IA propose des variantes stylistiques et aide à maintenir la cohérence narrative. Les élèves apprennent à négocier avec l’outil et à critiquer ses propositions. Autre approche : l’IA sert à générer des versions initiales que les élèves évaluent, corrigent et enrichissent collectivement.

L’exercice de l’esprit critique. La classe est divisée en équipes dont le but est de trouver le plus grand nombre d’erreurs factuelles dans un essai produit par l’IA.

L’évaluation. Puisque l’IA peut générer des résultats finis, l’évaluation des exercices doit principalement porter sur le processus plutôt que sur le produit. Par exemple, on peut évaluer la capacité de l’élève à interroger et critiquer l’IA, à détecter les hallucinations, à améliorer les propositions de la machine grâce à sa propre culture et à aider les autres étudiants dans leurs interactions avec la machine.

Les outils

Comme il se doit, le choix des outils ne doit venir qu’après deux étapes préalables : 1) la détermination des savoirs, savoir-faire et savoir-être à acquérir ; 2) la détermination des stratégies pédagogiques.

Il me semble important d’habituer les étudiants à une interaction critique avec les IA générales utilisées par le grand public. ChatGPT autorise les conversations de groupe, génère des textes et simule des débats. Perplexity AI aide à la recherche documentaire et pointe vers les sources ; elle est idéale pour initier les élèves à la vérification. Claude d’Anthropic est bonne pour traiter de longs documents, synthétiser et reformuler des idées. Gemini est l’IA de Google. Grok permet d’accéder aux dernières nouvelles presque en temps réel.

Listons maintenant quelques outils spécialisés.

- NotebookLM de Google occupe une place particulière car il limite l’IA aux documents fournis par l’utilisateur. C’est l’outil idéal pour s’abreuver à une mémoire collective sans se perdre dans les hallucinations.

- Mizou est une plateforme permettant aux enseignants de créer des “chatbots” spécialisés avec des instructions strictes (ex: “Ne donne jamais la réponse, pose des questions”). Idéal pour le dialogue socratique en binôme. L’IA n’est pas là pour gaver d’informations, mais pour susciter la curiosité.

- Khanmigo (Khan Academy) c’est un tuteur IA conçu pour guider l’élève sans faire le travail à sa place, facilitant l’entraide entre élèves sur des points de blocage spécifiques.

- Padlet permet de transformer un mur d’idées déposées par les élèves en une carte mentale ou un plan structuré par IA.

- Canva Magic Studio est utilisé en groupe pour passer d’un concept textuel collectif à une présentation visuelle, forçant les élèves à discuter de la pertinence des images et métaphores générées.

- Socratique par Google aide à la résolution de problèmes pas à pas.

Conclusion : une approche résolument humaniste

Sur le plan de la philosophie de l’éducation, ne négligeons jamais d’enrichir les mémoires personnelles des étudiants. Ce n’est pas parce que “tout” se trouve sur internet que nous devons cesser de cultiver notre mémoire individuelle, qui est le fondement de la pensée vivante. La pensée critique se tisse en effet dans une dialectique entre la mémoire collective (mobilisée aujourd’hui par l’IA), la mémoire personnelle de chacun d’entre nous et le dialogue ouvert – contradictoire et complice – avec nos pairs et contemporains. Plus riche est notre mémoire personnelle et mieux nous pouvons exploiter les ressources de l’IA, poser les bonnes questions, repérer les hallucinations, éclairer les impensés. Plus nous avons développé notre esprit critique et mieux nous contrôlons “la machine”. En aucun cas l’IA ne peut se substituer à la lecture de « vrais » textes (dont les auteurs sont humains) et encore moins à l’ignorance. Mais elle peut servir de conseillère et d’entraîneuse infatigable pour nos apprentissages. Ignorants, nous serons manipulés et induits en erreur par les modèles de langue. Par contraste, plus nous sommes savants et mieux nous pouvons maîtriser une IA qui, ne nous y trompons pas, devient l’environnement technique de la pensée, le nouveau sensorium.

Pour ceux qui voudraient écouter l’ensemble du colloque, voici le lien you-tube : https://www.youtube.com/watch?v=UudhPyHlJQ8&t=1s