Comment penser la nouvelle sphère publique numérique? Je commencerai par évoquer le contexte anthropologique et démographique du basculement de la sphère publique dans l’environnement numérique. Dans un second temps, j’analyserai les nouvelles formes de mémoire et de communication supportées par le nouveau médium. J’évoquerai ensuite les figures de la domination et de l’aliénation propres à ce milieu de communication. Je terminerai, comme il se doit, par quelques perspectives d’émancipation.

1 Le contexte

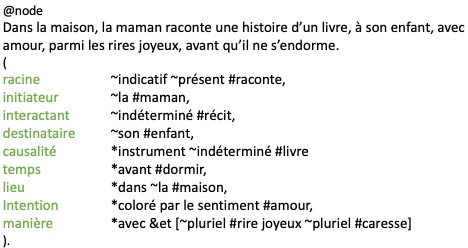

Une nouvelle époque de la culture

Un des facteurs principaux de l’évolution des écosystèmes d’idées réside dans le dispositif matériel de production et de reproduction des symboles, mais aussi dans les systèmes « logiciels » d’écriture et de codage de l’information. Au cours de l’histoire, les symboles (avec les idées qu’ils portaient) ont été successivement pérennisés par l’écriture, allégés par l’alphabet et le papier, multipliés par l’imprimerie et les médias électriques.

A chaque étape, de nouvelles formes politiques sont apparues : villes, palais-temples et premiers états avec l’écriture, empires et cités avec l’alphabet ou le papier, états nations avec l’imprimerie et les médias électroniques.

Les symboles sont aujourd’hui numérisés et calculés, c’est-à-dire qu’une foule de robots logiciels – les algorithmes – les enregistrent, les comptent, les traduisent et en extraient des patterns. Les objets symboliques (textes, images fixes ou animées, voix, musiques, programmes, etc.) sont non seulement enregistrés, reproduits et transmis automatiquement, ils sont aussi générés et transformés de manière industrielle. En somme, l’évolution culturelle nous a menés au point où les écosystèmes d’idées se manifestent sous l’avatar de données animées par des algorithmes dans un espace virtuel ubiquitaire. Et c’est dans cet espace que se nouent, se maintiennent et se dénouent les liens sociaux, là que se jouent désormais les drames de la Polis…

Le basculement démographique

L’hypothèse d’une mutation anthropologique rapide et de grande ampleur se fonde sur des données quantitatives qui ne prêtent pas à controverse.

Accès aux ordinateurs

Concernant l’accès aux ordinateurs, on peut considérer que 0,1 pour cent de la population mondiale avait un accès direct à un ordinateur en 1975 (avant la révolution de l’ordinateur personnel). Cette proportion se montait à 20% dans les pays riches en 1990 (avant la révolution du Web). En 2022, pour les pays européens, la proportion oscillait entre 65% (Grèce) et 95% (Luxembourg). A noter que ces derniers chiffres ne prennent pas en compte les téléphones portables.

Accès à l’Internet

La proportion de la population mondiale qui avait accès à l’Internet était d’environ 1% en 1990 (donc avant le Web), de 4% en 1999, de 24% en 2009, de de 51% en 2018 et de 65% en 2023. Selon l’Organisation internationale des télécommunications, environ 5 milliards de personnes sont des internautes. Toujours pour 2023, mais seulement en Europe, la proportion de la population branchée à l’Internet se monte à 93% (ce sont les données de l’Union Européenne).

Prise de connaissance des nouvelles

Pour compléter ces statistiques avec des données concernant plus directement la politique, 40% des européens et 50% des américains et canadiens prennent connaissance des nouvelles par les médias sociaux (je dis bien les médias sociaux et pas l’Internet en général). On dépasse partout les 50% pour les moins de quarante ans. Pour les données spécifiques concernant la lecture des journaux par opposition à la lecture de textes en ligne, les moins de trente ans lisent les nouvelles en ligne à 80% (données du Pew Research Center).

2 Mémoire et communication numérique

La nouvelle sphère publique

En somme, moins d’un siècle après l’invention des premiers ordinateurs, plus de soixante cinq pour cent de la population mondiale est branchée à l’internet et la mémoire du monde est numérisée. Qu’une information se trouve en un point du réseau et la voici partout. Du texte statique sur papier, nous sommes passé à l’hypertexte ubiquitaire, puis à l’Architexte surréaliste qui rassemble tous les symboles. Une mémoire virtuelle s’est mise à croître, secrétée par des milliards de vivants et de morts, fourmillant de langues, de musiques et d’images, grosse de rêves et de fantasmes, mêlant la science et le mensonge. La nouvelle sphère publique est multimédia, interactive, mondiale, fractale, stigmergique et – désormais – médiée par l’intelligence artificielle.

La nouvelle sphère publique est mondiale. Aussi bien le web que les grands médias sociaux comme Facebook, Twitter, LinkedIn, Telegram, Reddit, etc. sont internationaux et multilingues. La traduction automatique a atteint un point ou l’on peut maintenant comprendre, avec quelques erreurs, ce qu’un internaute écrit dans une autre langue. J’ajoute que, parallèlement à la traduction, la synthèse automatique de longs textes progresse, ce qui ajoute à la porosité des diverses bulles cognitives et sémantiques.

La sphère publique numérique est fractale, c’est-à-dire qu’elle se subdivise en sous-groupes, eux-mêmes subdivisés en sous-groupes, et ainsi de suite récursivement, avec toutes les réunions et intersections imaginables. Ces subdivisions recoupent des distinctions de plateformes, de langues, de zones géographiques, de centres d’intérêts, d’orientations politiques, etc. On peut donner comme exemples les groupes Facebook ou LinkedIn, les serveurs Discord, les canaux YouTube ou Telegram, les communautés de Reddit, etc.

L’intelligence collective stigmergique

Si l’échange de messages point à point a toujours lieu, la majeure part de la communication sociale s’effectue désormais de manière stigmergique. La notion de stigmergie est une des clés de la compréhension du fonctionnement de la sphère publique numérique. On distingue traditionnellement trois schémas de communication : un-un, un-plusieurs et plusieurs-plusieurs. Le schéma un-un correspond au dialogue, au courrier postal classique ou au téléphone traditionnel. Le schéma un-plusieurs décrit le dispositif où un éditeur/émetteur central envoie ses messages à une masse de récepteurs dits « passifs ». Ce dernier schéma correspond à la presse, au disque, à la radio et à la télévision. Internet représente une rupture parce qu’il permet à l’ensemble des participants d’émettre pour un grand nombre de récepteurs selon un schéma en réseau décentralisé « plusieurs vers plusieurs ». Cette dernière description est néanmoins trompeuse. En effet, si tout le monde émet pour tout le monde (ce qui est le cas), tout le monde ne peut pas écouter tout le monde. Ce qui se passe en réalité est que les internautes contribuent à alimenter une mémoire commune et prennent connaissance en retour du contenu de cette mémoire par l’intermédiaire de procédures de recherche et de sélection automatisées. Ce sont les fameux algorithmes de Google, (Page Rank), de Facebook, de Twitter, d’Amazon (recommandations), etc.

L’étymologie grecque explique assez bien le sens du mot « stigmergie » : des marques (stigma) sont laissées dans l’environnement par l’action ou le travail (ergon) de membres d’une collectivité, et ces marques guident en retour – et récursivement – leurs actions. Le cas classique est celui des fourmis qui laissent une traîne de phéromones sur leur passage lorsqu’elles ramènent de la nourriture à la fourmilière. L’odeur des phéromones incite d’autres fourmis à remonter leurs traces pour découvrir le butin et ramener des vivres à la ville souterraine en laissant par terre à leur tour un message parfumé.

On peut prétendre que toute forme d’écriture qui n’est pas précisément adressée est une forme de communication stigmergique : des traces sont déposées pour une lecture à venir et font office de mémoire externe d’une communauté. Si le phénomène est fort ancien, il a pris depuis le début du siècle une nouvelle ampleur. Plongés dans la nouvelle sphère publique numérique, nous communiquons par l’intermédiaire de la masse océanique de données qui nous rassemble. Les encyclopédistes de Wikipédia et les programmeurs de GitHub collaborent par l’intermédiaire d’une même base de données. A notre insu, chaque lien que nous créons, chaque étiquette ou hashtag apposée sur une information, chaque acte d’évaluation ou d’approbation, chaque « j’aime », chaque requête, chaque achat, chaque commentaire, chaque partage, toutes ces opérations modifient subtilement la mémoire commune, c’est-à-dire le magma inextricable des rapports entre les données. Notre comportement en ligne émet un flux continuel de messages et d’indices qui transforment la structure de la mémoire et contribuent à orienter l’attention et l’activité de nos contemporains. Nous déposons dans l’environnement virtuel des phéromones électroniques qui déterminent en boucle l’action des autres internautes et qui entraînent par-dessus le marché les neurones formels des intelligences artificielles (IA).

Le rôle de l’Intelligence artificielle dans la nouvelle sphère publique

Le cerveau biologique abstrait le détail des expériences actuelles en schémas d’interactions, ou concepts, codés par des patterns de circuits neuronaux. De la même manière, les modèles neuronaux de l’IA condensent les données innombrables de la mémoire numérique. Ils virtualisent les données actuelles en patterns et en patterns de patterns. Conditionnés par leur entraînement, les algorithmes peuvent alors reconnaître et reproduire des données correspondant aux formes apprises. Mais parce qu’ils ont abstrait des structures plutôt que de tout enregistrer, les voici capables de conceptualiser correctement des formes (d’image, de textes, de musique, de code…) qu’ils n’ont jamais rencontrées et de produire une infinité d’arrangements symboliques nouveaux. C’est pourquoi l’on parle d’intelligence artificielle générative.

La mémoire numérique est détachée de son lieu d’émission et de réception, mise en commun, en attente de lecture, suspendue dans les “nuages” de l’Internet, logicielle. Cette masse de donnée est maintenant compressée par des modèles neuronaux. Et les patterns cachés dans les myriades de couches et de connexions des cerveaux électroniques font retomber en pluie des objets symboliques inédits. Nous ne semons des données que pour récolter du sens.

L’IA nous offre un nouvel accès à la mémoire numérique mondiale. C’est aussi une manière de mobiliser cette mémoire pour automatiser des opérations symboliques de plus en plus complexes, impliquant l’interaction d’univers sémantiques et de systèmes de comptabilité hétérogènes.

3 Le côté obscur

L’état-plateforme et la nouvelle bureaucratie dans les nuages

Si les analyses qui précèdent ont quelque validité, le pouvoir politique se joue pour une bonne part dans la sphère publique numérique. Or son contrôle ultime se trouve « dans les nuages », aux mains des bureaucraties célestes qui calculent les interactions sociales et la mémoire. Les nuages, c’est-à-dire les réseaux de centres de données possédées par l’oligopole des GAFAM, BATX et compagnie. C’est pourquoi les prétendants à l’hégémonie politique mondiale, essentiellement les américains et les chinois, s’allient avec les seigneurs des données – ou les soumettent – parce que les oligarques numériques détiennent le contrôle matériel de la mémoire mondiale et de la sphère publique. Eux seuls ont d’ailleurs la capacité de mémoire et la puissance de calcul nécessaires à l’entraînement des modèles d’IA généraux dits « fondationnels ». Ce que j’appelle un État-Plateforme résulte de l’imbrication d’une super-puissance politique avec une fraction de l’oligarchie numérique.

La bureaucratie des nuages est plus efficace que celle des états-nations, héritée de l’ère de l’imprimerie. Déjà, plusieurs fonctions gouvernementales ou régaliennes sont assurées par les grandes plateformes ou par des réseaux numériques « décentralisés ». La liste qui suit n’est pas close :

- Vérification de l’identité des personnes, reconnaissance faciale

- Cartographie et cadastre

- Création monétaire

- Régulation du marché

- Éducation et recherche

- Fusion de la défense et de la cyberdéfense

- Contrôle de la sphère publique, censure, propagande, “nudge” (coup de pouce statitique)

- Surveillance

- Biosurveillance

Les médias sociaux : addictions et manipulations

Notre allégeance aux seigneurs des données vient de la puissance de leurs centres de calcul, de leur efficacité logicielle et de la simplicité de leurs interfaces. Elle trouve aussi sa source dans notre dépendance à une architecture sociotechnique toxique, qui utilise la stimulation dopaminergique et les renforcements narcissiques addictifs de la communication numérique pour nous faire produire toujours plus de données. On sait combien, de ce point de vue, la santé mentale des populations adolescentes est à risque. En plus de la biopolitique évoquée par Michel Foucault, il faut donc maintenant considérer une psychopolitique à base de neuromarketing, de données personnelles et de gamification du contrôle.

Il faut s’y faire : la Polis a basculé dans la grande base de données mondiale de l’Internet. Dès lors, les luttes de pouvoir – toutes les luttes de pouvoir, qu’elles soient économiques, politiques ou culturelles – sont reconduites et compliquées dans le nouvel espace numérique. Sur le terrain glissant des médias sociaux, les camps qui s’affrontent disposent leurs armées de trolls coordonnées en temps réel, équipées de bots dernier cri, renseignées par l’analyse automatique des données et augmentées par l’apprentissage machine. Dans la guerre civile mondiale qui fait rage, politique intérieure et extérieure inextricablement mêlées, les nouveaux mercenaires sont les influenceurs.

Mais toutes ces nouveautés n’invalident pas les règles classiques de la propagande, toujours d’actualité : répétition continuelle, simplicité des mots d’ordre, images mémorables, provocation affective et résonnance identitaire. Personne n’oublie non plus les conseils avisés de Machiavel pour amener l’ennemi à s’auto-détruire : « La guerre secrète consiste à se mettre dans la confidence d’une ville divisée, à se porter pour médiateur entre les deux partis jusqu’à ce qu’ils en viennent aux armes : et quand l’épée est enfin tirée à donner des secours prudemment dosés au parti le plus faible, autant dans le but de faire durer la guerre et de les laisser se consumer les uns par les autres, que pour se garder, par un secours trop massif, de révéler son dessein de les opprimer et de les maîtriser tous deux également. Si l’on suit soigneusement cette marche, on arrive presque toujours à son but. »[1]

La tête baissée sur nos smartphones, nous faisons tourner en boucle les stéréotypes qui renforcent nos identités éclatées et nos mémoires courtes sous le regard narquois des experts de l’intoxication, communicants stipendiés, spécialistes du marketing et agents d’influence géopolitiques…

IA et domination culturelle

Poursuivons cette revue des côtés obscurs de la nouvelle sphère publique par les enjeux de domination culturelle liés à l’Intelligence artificielle. On parle beaucoup des « biais » de tel ou tel modèle d’intelligence artificielle, comme s’il pouvait exister une IA non-biaisée ou neutre. Cette question est d’autant plus importante que, comme je l’ai suggéré plus haut, l’IA devient notre nouvelle interface avec les objets symboliques : stylo universel, lunettes panoramiques, haut-parleur général, programmeur sans code, assistant personnel. Les grands modèles de langue généralistes produits par les plateformes dominantes s’apparentent désormais à une infrastructure publique, une nouvelle couche du méta-médium numérique. Ces modèles généralistes peuvent être spécialisés à peu de frais avec des jeux de données issues d’un domaine particulier et de méthodes d’ajustement. On peut aussi les munir de bases de connaissances dont les faits ont été vérifiés.

Les résultats fournis par une IA découlent donc de plusieurs facteurs qui contribuent tous à son orientation ou si l’on préfère, à ses « biais ». a) Les algorithmes proprement dits sélectionnent les types de calcul statistique et les structures de réseaux neuronaux. b) Les données d’entraînement favorisent les langues, les cultures, les options philosophiques, les partis-pris politiques et les préjugés de toutes sortes de ceux qui les ont produites. c) Afin d’aligner les réponses de l’IA sur les finalités supposées des utilisateurs, on corrige (ou on accentue!) « à la main » les penchants des données par ce que l’on appelle le RLHF (Reinforcement Learning from Human Feed-back – en français : apprentissage par renforcement à partir d’un retour d’information humain). d) Finalement, comme pour n’importe quel outil, l’utilisateur détermine les résultats au moyen de consignes en langue naturelle (les fameux prompts). Il faut noter que des communautés d’utilisateurs s’échangent et améliorent collaborativement de telles consignes. La puissance de ces systèmes n’a d’égal que leur complexité, leur hétérogénéité et leur opacité. Le contrôle règlementaire de l’IA, sans doute nécessaire, semble difficile.

4 Perspectives d’émancipation

Littéracie numérique et pensée critique

Malgré tout ce qui vient d’être dit, la sphère publique du XXIe siècle est plus ouverte que celle du XXe siècle : les citoyens des pays démocratiques y jouissent d’une grande liberté d’expression et peuvent choisir leurs sources d’information parmi un vaste éventail de spécialisations thématiques, de langues et d’orientations politiques. Cette liberté d’expression et d’information, la nouvelle puissance distribuée de création et d’analyse de données, sans oublier les possibilités de coordination sociale offertes par le nouveau médium, tout cela ne représente que des potentialités émancipatrices. Seule une véritable éducation à la pensée critique dans le nouvel environnement de communication permettra d’actualiser ce potentiel de citoyenneté renouvelée. Pour fixer les idées, une étude de la BBC a récemment montré que 50% des jeunes gens de 12 à 16 ans croient aux nouvelles partagées sur les médias sociaux sans les vérifier. Et nous savons d’expérience que les enfants ne sont pas les seuls sujets crédules. Idéalement, la nouvelle éducation à la pensée critique devrait enseigner aux futurs citoyens à s’organiser comme de petites agences de renseignement autonomes qui rangent leurs centres d’intérêts par ordre de priorité, sélectionnent soigneusement des sources diversifiées, analysent les données à partir d’hypothèses explicites et maintiennent une classification pertinente de leur mémoire numérique personnelle. Il faut apprendre à discerner les sources de données en termes de catégories organisatrices, de récits dominants et d’agendas. On inculquera le réflexe journalistique élémentaire de croiser les sources ainsi identifiées. Enfin, les élèves devraient être entraînés à l’intelligence collective stigmergique et à l’apprentissage collaboratif.

Pour une gouvernance de la sphère publique numérique

Je me contenterai ici d’indiquer quelques grandes orientations d’une nécessaire gouvernance de la nouvelle sphère publique plutôt que de déterminer précisément les moyens d’y parvenir. Si le pilotage par gros temps peut nécessiter de nombreux détours, le cap est clair : il s’agit de perfectionner, autant que possible, la dimension réflexive d’une intelligence collective déjà en acte.

- A l’appui de cette finalité, la transparence des processus en ligne semble une condition sine qua non. Je vise en particulier, mais pas seulement, une description claire, brève et en langue naturelle des algorithmes et des données d’entraînement des IA.

- A l’exemple de Wikimédia, efforçons-nous de maximiser les « communs » de la connaissance.

- Ouvrons les jeux de données et les algorithmes selon la voie tracée par le mouvement du logiciel libre.

- Assurons la souveraineté pratique et légale des individus et des groupes sur les données qu’ils produisent.

- Enfin, décentralisons la gouvernance des interactions en ligne en favorisant les procédures consensuelles. Le mouvement social qui porte la blockchain indique ici un chemin possible.

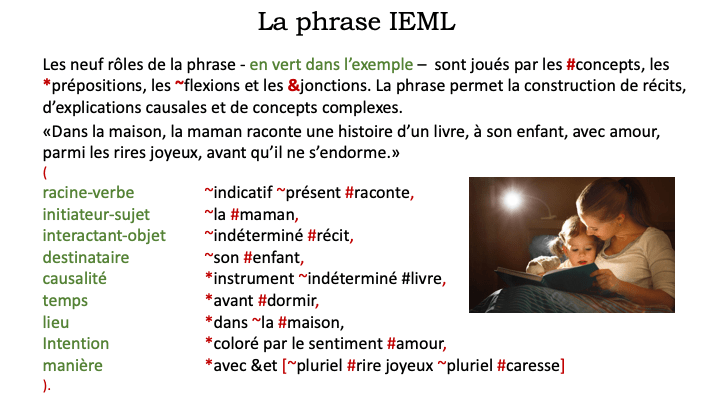

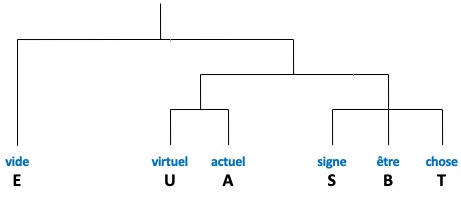

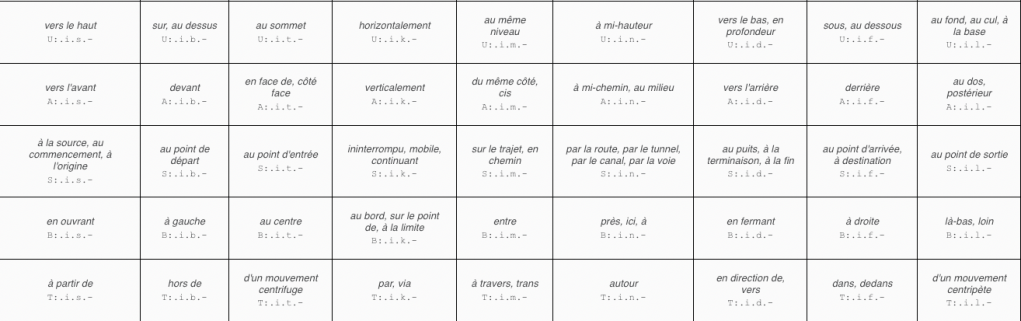

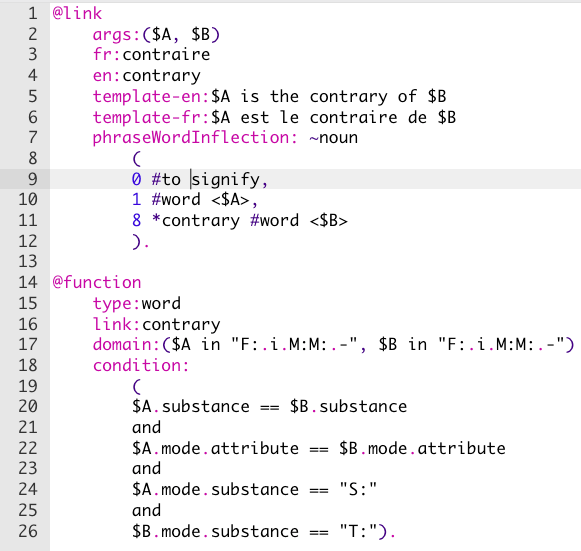

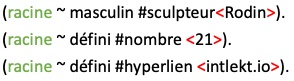

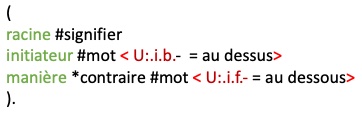

Afin d’apporter ma pierre au projet d’une intelligence collective réflexive j’ai inventé une langue (IEML, Information Economy MetaLanguage) ayant la même capacité d’expression et de traduction que les langues naturelles mais qui a aussi la régularité d’une algèbre, permettant ainsi un calcul de la sémantique. Cette langue pourrait servir de système de coordonnées sémantique à la nouvelle sphère publique. Elle contribuerait ainsi à transformer la mémoire numérique en miroir de nos intelligences collectives. Dès lors, une boucle de rétroaction plus fluide entre les écosystèmes d’idées et les communautés qui les entretiennent nous rapprocherait de l’idéal d’une intelligence collective réflexive au service du développement humain et d’une démocratie renouvelée. Il ne s’agit pas d’entretenir quelque illusion sur la possibilité d’une transparence totale, mais plutôt d’ouvrir la voie à l’exploration critique d’un univers de sens infini.

[1] Discours sur la première décade de Tite-Live. La Pléiade, Gallimard, Paris, p. 588